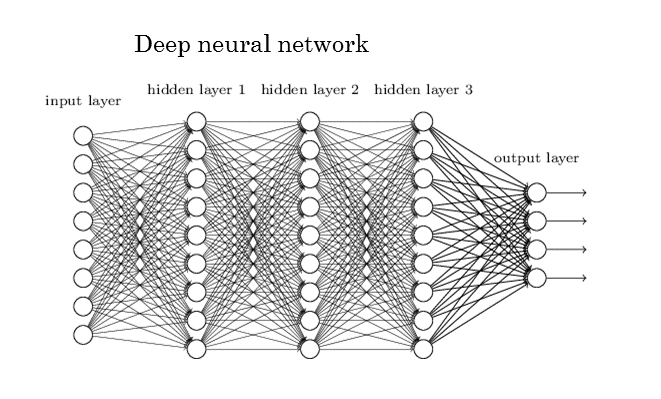

딥러닝하면 가장 먼저 접하는 저 신경망 그림은 뭔가 복잡해 보이지만 찬찬히 뜯어보면 비교적 단순하다. 위 그림을 직관적으로 받아들여보면 input layer는 우리가 예측 또는 분류할 때 쓸만할 것으로 예상되는 데이터에 해당한다. 즉 집값 예측이라고 한다면 평수, 방 개수 등등이 되겠다. 위 동그라미들을 이어주는 선들은 모두 가중치 $w$에 해당하며 1~8번 input 데이터에 각각 다른 가중치를 곱한 뒤 모두 더하는 내적을 수행한 결과가 hidden layer 1 이 된다. 식으로 표현하기 위해 input 데이터를 $x$라고 한다면 $w_1x_1 + w_2x_2....+b$ 로 표현이 된다. 이 식은 input이 8개 hidden layer 1이 9개 이므로 총 72개의 $w$가 필요할 것이지만 아무리..